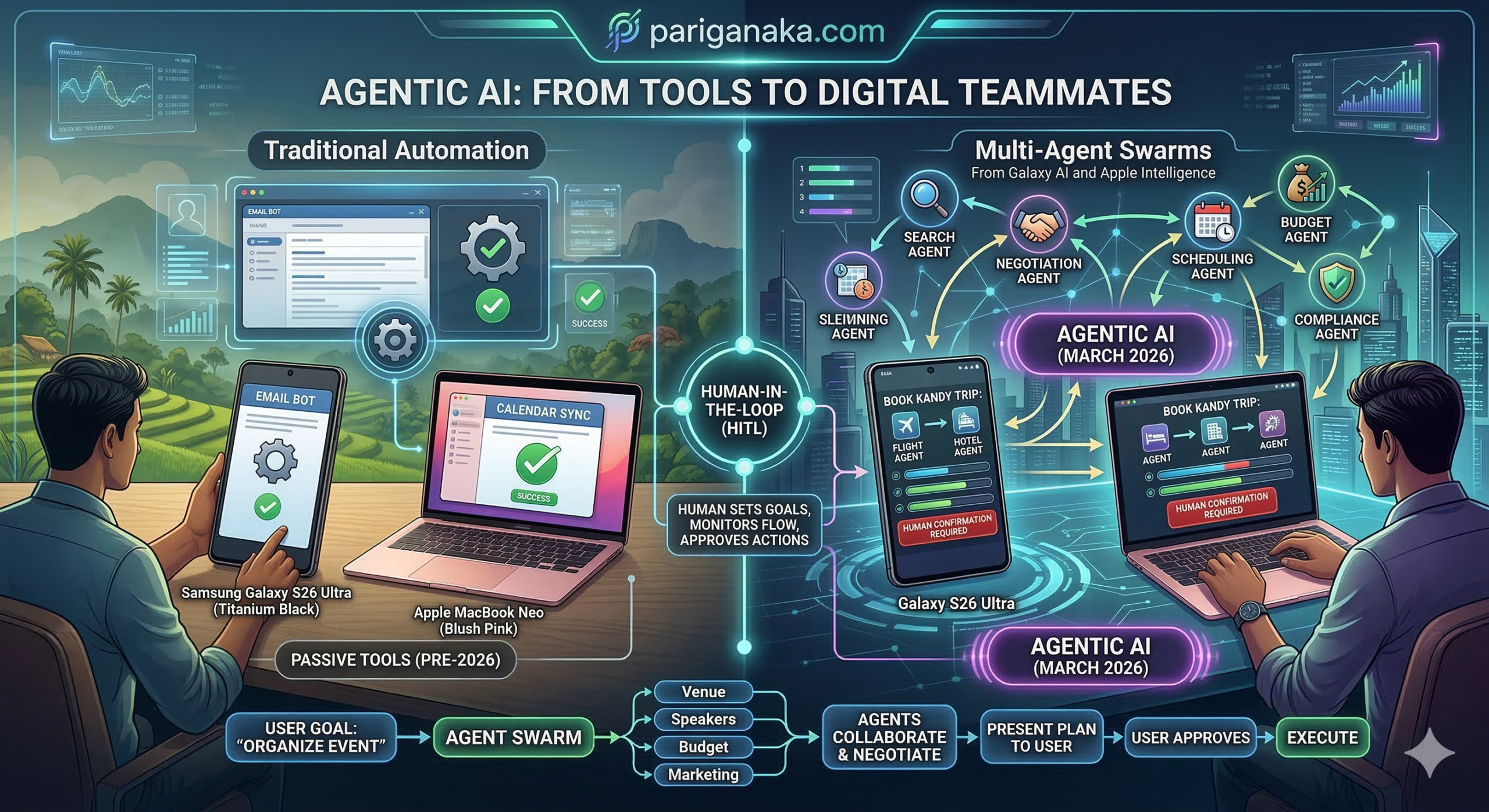

අප මීට පෙර ලිපියෙන් සාකච්ඡා කළ පරිදි, Samsung Galaxy AI සහ Apple MacBook Neo (A18 Pro) හරහා දැන් අප වෙත පැමිණ ඇත්තේ හුදෙක් ප්රශ්නවලට පිළිතුරු දෙන AI තාක්ෂණයක් පමණක් නොවේ. දැන් අප සතු වන්නේ අප වෙනුවෙන් තීරණ ගෙන ක්රියා කරන “නියෝජිත AI” (Agentic AI) පද්ධති වේ.

මෙමඟින් අපගේ එදිනෙදා වැඩකටයුතු වඩාත් කාර්යක්ෂම වන නමුත්, pariganaka.com කියවන ඔබ මෙහි ඇති සදාචාරාත්මක සහ ප්රායෝගික අභියෝග පිළිබඳව අවධානය යොමු කිරීම අතිශය වැදගත්ය.

1. වගකීම කාගේද? (The Problem of Responsibility)

AI නියෝජිතයෙකු අතින් වරදක් සිදු වූ විට එහි වගකීම පැවරෙන්නේ කාටද? මෙය 2026 වසරේ අප මුහුණ දෙන ප්රධානතම ගැටලුවයි.

උදාහරණයක් ලෙස, ඔබේ ඊමේල් කළමනාකරණය කිරීමට ඔබ AI නියෝජිතයෙකුට පවරා ඇතැයි සිතන්න. “රුපියල් ලක්ෂයකට වඩා අඩු ව්යාපෘති ප්රතික්ෂේප කරන්න” යන නියෝගය වැරදියට වටහා ගන්නා AI නියෝජිතයා, රුපියල් කෝටියක වැදගත් ව්යාපෘතියක් ප්රතික්ෂේප කළහොත් එහි වගකීම ගත යුත්තේ කවුද?

- නියෝගය ලබා දුන් ඔබද?

- AI පද්ධතිය නිර්මාණය කළ සමාගමද?

දැනට පවතින නීතිමය රාමුව අනුව, ඕනෑම AI නියෝජිතයෙකු සිදු කරන ක්රියාවක අවසන් වගකීම එය ක්රියාත්මක කළ පුද්ගලයා සතු වේ. එබැවින්, ඔබ සැමවිටම මතක තබා ගත යුතු රීතිය වන්නේ: “අසාර්ථක වුවහොත් ඔබට දරාගත නොහැකි කිසිදු තීරණයක් AI නියෝජිතයෙකුට තනිවම ගැනීමට ඉඩ නොදෙන්න.”

2. සීමාවන් සහ මානව අභිප්රාය (Guardrails and Human Intent)

සාර්ථක AI නියෝජිතයෙකු යනු මිනිස් පාලනයෙන් බැහැර වූවෙක් නොවේ. එය “සොර්බා ද බුද්ධා” (Zorba the Buddha) සංකල්පය මෙන් විය යුතුය—එනම්, ක්රියාශීලී විය යුතු අතරම විනයගරුක සහ බුද්ධිමත් විය යුතුය.

නිවැරදි AI නියෝජිතයෙකු:

- සීමාවන් හඳුනයි: නීති විරෝධී හෝ අනතුරුදායක කිසිදු ක්රියාවක් සිදු නොකරයි.

- අනුමැතිය විමසයි: සාමාන්ය වැඩකටයුතු (උදා: Calendar එක update කිරීම) තනිවම කළත්, මුදල් ගනුදෙනු හෝ නිල නිවේදන නිකුත් කිරීමට පෙර ඔබෙන් අනුමැතිය ලබා ගනී.

- පැහැදිලි වාර්තාවක් ලබා දෙයි: තමන් කළ දේ සහ ඊළඟට කිරීමට යන දේ පිළිබඳව ඕනෑම වේලාවක ඔබට පරීක්ෂා කළ හැකි වාර්තාවක් (Log) ඉදිරිපත් කරයි.

3. ශ්රී ලංකාවේ තත්ත්වය සහ පක්ෂග්රාහීත්වය (Bias)

ශ්රී ලංකාවේ අප සිංහල සහ දෙමළ භාෂාවෙන් වැඩ කළ හැකි AI පද්ධති දියත් කළත්, ඒවායේ ඇති “පක්ෂග්රාහීත්වය” (Bias) පිළිබඳව සැලකිලිමත් විය යුතුය. ගෝලීය වශයෙන් පුහුණු කළ AI මාදිලි සමහර විට අපේ රටේ සංස්කෘතික හෝ දේශීය වටිනාකම් නිසි ලෙස හඳුනා නොගැනීමට ඉඩ ඇත.

විශේෂයෙන්ම රැකියා සඳහා පුද්ගලයින් තේරීමේදී හෝ කෘෂිකාර්මික තීරණ ගැනීමේදී AI භාවිතා කරන්නේ නම්, එය අපේ දේශීය සන්දර්භයට (Context) ගැළපෙන බව තහවුරු කර ගැනීම සඳහා සදාචාරාත්මක විගණනයක් (Ethical Audit) අවශ්ය වේ.

4. විසඳුම: “මිනිසා පාලනයේ තබා ගැනීම” (Human-in-the-Loop)

2026 වසරේ වඩාත්ම සාර්ථක තාක්ෂණික මාදිලිය වන්නේ Human-in-the-Loop (HITL) ක්රමයයි. මෙහිදී AI විසින් වැඩෙන් 95%ක් සම්පූර්ණ කරන අතර, අවසන් “Execute” බොත්තම එබීම හෝ තීරණය තහවුරු කිරීම මිනිසා විසින් සිදු කරනු ලැබේ.

මෙමඟින් තාක්ෂණයේ වේගයත්, මිනිසාගේ විචාර බුද්ධියත් යන දෙකම එකවර ලබා ගත හැක.

Leave a Reply